作者:肯尼斯·o·斯坦利,杰夫·克伦

我代表Uber人工智能实验室团队发言,该团队还包括Joel Lehman、Jay Chen、Edoardo Conti、Vashisht Madhavan、Felipe Petroski Such和张兴文。

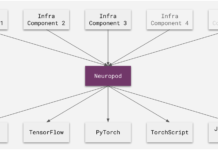

在深度学习领域,具有许多层和数百万个连接的深度神经网络(dnn)现在通过随机梯度下降(SGD)进行常规训练。许多人认为SGD有效地计算梯度的能力对这种能力至关重要。然而,我们将发布一套五篇论文,支持这一新兴认识neuroevolution通过进化算法对神经网络进行优化,也是训练深度神经网络解决强化学习(RL)问题的有效方法。超级有很多区域吗机器学习可以改善其操作,开发包括神经进化在内的广泛强大的学习方法将帮助我们实现开发更安全、更可靠的交通解决方案的使命。

遗传算法作为训练深度神经网络的竞争性替代方案

使用我们发明的一种新技术来有效地进化dnn,我们惊讶地发现这是一个极端简单遗传算法(GA)可以训练具有超过400万个参数的深度卷积网络来从像素中玩雅达利游戏,并且在许多游戏中优于现代深度强化学习(RL)算法(例如DQN和A3C)或进化策略(ES),同时由于更好的并行化,速度也更快。这一结果令人惊讶,因为GAs不是基于梯度的,没有被预期能很好地扩展到如此大的参数空间,而且因为使用GAs在RL中匹配或优于最先进的技术被认为是不可能的。我们进一步展示了改进GA功率的现代GA增强,例如科技查新,也可以在DNN尺度上工作,并可以促进探索以解决欺骗性问题(具有挑战性的局部最优),这些问题阻碍了奖励最大化算法,如q -学习(DQN)、策略梯度(A3C)、ES和GA。

|

|

| 这个GA保单在冻伤上得到10500分。DQN, AC3和ES在这场比赛中得分低于1000分。 | GA在《Asteroids》中表现出色。它的平均表现优于DQN和ES,但不优于A3C。 |

通过梯度计算的安全突变

在另一篇论文,我们展示了如何将梯度与神经进化结合起来,以提高进化复发性和非常深的神经网络的能力,使dnn的进化超过一百层,这一水平远远超出了以前通过神经进化所显示的可能性。我们通过计算网络输出的梯度关于权重(即不是传统深度学习中的误差梯度),使随机突变的校准能够更细致地处理最敏感的参数,从而解决了大型网络中随机突变的主要问题。

这两个动画都展示了可以解决迷宫的单个网络的一批突变(开始在左下,目标在左上)。正常突变大多失去了到达终点的能力,而安全突变在很大程度上保留了这种能力,同时仍能产生多样性,这说明了安全突变的显著优势。

ES与SGD有什么关系

我们的论文补充了已经开始实现,也就是OpenAI的一个团队首先注意到了这一点神经进化的进化策略多样性可以在深度RL任务中对深度神经网络进行优化。然而,到目前为止,这一结果的更广泛影响仍然是一些猜测的主题。为与ES的进一步创新奠定基础,我们更深入地了解ES与SGD的关系综合研究它检查了ES梯度近似实际上与MNIST上SGD计算的每个小批的最佳梯度有多接近,以及这个近似必须有多接近才能表现良好。我们表明,如果提供足够的计算来改善其梯度近似,ES可以在MNIST上达到99%的准确率,这暗示了为什么ES将越来越多地成为深度RL的有力竞争者,在深度RL中,随着并行计算的增加,没有任何方法具有访问完美梯度信息的特权。

ES不仅仅是传统的有限差分

为了进一步理解,配套研究从经验上证实,ES(具有足够大的扰动大小参数)的行为与SGD不同,因为它优化了a的预期奖励人口由概率分布(a云在搜索空间中),而SGD优化单个策略的奖励(a点在搜索空间)。这种变化导致ES访问搜索空间的不同区域,无论是好是坏(这两种情况都有说明)。对一组参数扰动进行优化的另一个结果是ES获得了通过SGD无法获得的鲁棒性。强调ES对一组参数进行优化也强调了ES和贝叶斯方法。

TRPO学到的对步行者权重的随机扰动比ES学到的对同等质量步行者的随机扰动的稳定性差得多。原始的学习步行者位于每个九帧合成图的中心。

传统的有限差分(梯度下降)无法跨越低适应度的狭窄差距,而ES可以轻松跨越它,在另一侧找到更高的适应度。

ES会因高适应度路径变窄而停滞,而传统的有限差分(梯度下降)会毫无问题地遍历相同的路径,这与之前的视频一起说明了两种不同方法之间的区别和权衡。

改进ES勘探

深度神经进化的一个令人兴奋的结果是,以前为神经进化开发的工具集合现在成为增强深度神经网络训练的候选者。我们通过引入新算法将ES的优化能力和可扩展性与神经进化特有的方法相结合,通过a促进RL领域的探索人口每个人都有不同的行为方式。这种基于群体的探索不同于RL中的单智能体传统,包括最近在深度RL中的探索工作。我们的实验表明加入这种新的探索风格提高ES在许多需要探索以避免欺骗性局部最优的领域的性能,包括一些雅达利游戏和Mujoco模拟器中的类人运动任务。

使用超参数,ES会迅速收敛到局部最优值,即不出现氧气,因为这样做会暂时放弃获得奖励。然而,通过探索,智能体学会了上来获取氧气,从而在未来获得更高的奖励。请注意,Salimans等,2017没有报告ES,他们的超参数,遇到这个特定的局部最优值,但是没有探索的ES可以无限期地困在某个局部最优值上(而探索可以帮助它摆脱困境),正如我们的论文所示,这是一个普遍的观点。

|

|

|

| 西文 | ES /勘探 | 训练中的奖励 |

代理的任务是尽可能向前跑。ES永远学不会逃离欺骗的陷阱。然而,在探索的压力下,其中一个特工学会了绕过陷阱。

结论

对于有兴趣转向深度网络的神经进化研究人雷竞技是骗人的员来说,有几个重要的考虑:首先,这类实验比过去需要更多的计算;对于这些新论文中的实验,我们经常使用数百甚至数千个同时运行的cpu。然而,对更多cpu或gpu的渴望不应被视为一种负担;从长远来看,将进化扩展到大规模并行计算中心的简单性意味着神经进化可能是利用即将到来的世界的最佳时机。

新的结果与之前在低维神经进化中观察到的结果如此不同,以至于它们有效地推翻了多年的直觉,特别是在高维搜索的影响方面。一如既往在深度学习中发现在某个复杂的阈值之上,在高维的情况下,搜索实际上变得更容易,因为它不太容易受到局部最优的影响。虽然深度学习领域对这种思维方式很熟悉,但它的含义在神经进化中才刚刚开始被消化。

神经进化的重新出现是另一个例子,说明旧算法与现代计算量相结合可以惊人地发挥作用。神经进化的可行性很有趣,因为神经进化界发展出的许多技术立即在dnn规模上可用,每个都提供不同的工具来解决具有挑战性的问题。此外,正如我们的论文所示,神经进化搜索与SGD不同,因此提供了一种有趣的机器学习工具箱中的替代方法。我们想知道深度神经进化是否会像深度学习一样经历一次复兴。如果是这样的话,2017年可能标志着这个时代的开始,我们很兴奋地看到未来几年将会发生什么!

以下是我们今天发布的五篇论文,以及主要发现的摘要:

- 深度神经进化:遗传算法是训练用于强化学习的深度神经网络的竞争性替代方案

- 用一个简单的、传统的、基于群体的遗传算法进化dnn,该算法在硬的深度RL问题上表现良好。在Atari上,GA的表现与进化策略和基于q -学习(DQN)和策略梯度(A3C)的深度强化学习算法一样好。

- “深度遗传算法”成功地进化出了具有超过400万个自由参数的网络,这是有史以来使用传统进化算法进化出的最大的神经网络。

- 有趣的是,在某些情况下,遵循梯度并不是优化性能的最佳选择。

- 将dnn与新颖性搜索(一种探索算法,专为具有欺骗性或稀疏奖励函数的任务设计)相结合,以解决奖励最大化算法(例如GA和ES)失败的欺骗性高维问题。

- 显示深度GA的并行性优于ES、A3C和DQN,因此比ES、A3C和DQN更快,并实现了最先进的紧凑编码技术,可以以数千字节表示数百万个参数的dnn。

- 包括在雅达利随机搜索的结果。令人惊讶的是,在一些游戏中,随机搜索的性能大大优于DQN, A3C和ES,尽管它从未优于GA。

令人惊讶的是,通过随机搜索发现的DNN很好地发挥了冻伤,优于DQN、A3C和ES,但不优于GA。

- 通过输出梯度的深度和循环神经网络的安全突变

- 通过梯度进行安全突变(SM-G)通过测量网络对特定连接权重变化的敏感性,极大地提高了大型、深度和循环网络的突变效率。

- 计算的梯度输出与传统深度学习中的误差或损失梯度不同,它允许随机但安全的探索性步骤。

- 这两种类型的安全突变都不需要在该领域进行额外的试验或推广。

- 结果是:深度网络(超过100层)和大型循环网络现在只能通过SM-G的变体有效地进化。

- OpenAI进化策略与随机梯度下降的关系

- 通过比较不同条件下在MNIST中ES计算的近似梯度和SGD计算的精确梯度,探讨ES与SGD的关系。

- 开发快速代理,预测ES的预期性能与不同的人口规模。

- 介绍和演示加速和提高ES性能的不同方法。

- 有限摄动ES显著加快并行基础设施上的执行速度。

- No-mini-batch西文通过用为ES定制的不同方法替换为SGD设计的小批量约定来改进梯度估计:在算法的每次迭代中,将整个训练批的随机子集分配给ES总体的每个成员。这种特定于ES的方法为具有等效计算的ES提供了更好的精度,并且学习曲线比SGD平滑得多。

- 非小批量ES在测试运行中达到了99%的准确率,这是在这个监督学习任务中进化方法的最佳性能。

- 总体上有助于说明为什么ES能够在RL中竞争,在RL中,通过在领域中的试验获得的梯度信息对于性能目标的信息量比监督学习中要少。

- ES不仅仅是一个传统的有限差分逼近器

- 强调了ES和传统有限差分方法之间的一个重要区别,即ES优化解的最优分布(而不是一个最优解)。

- 一个有趣的结果是:ES发现的解对参数扰动具有鲁棒性。例如,我们表明,ES的类人行走解对参数扰动的鲁棒性明显高于GAs和TRPO找到的类似解。

- 另一个重要的结果是:ES有望解决一些传统方法无法解决的问题,反之亦然。简单的例子说明了ES和传统梯度跟随之间的不同动态。

- 通过寻求新奇的智能体种群改进深度强化学习的进化策略探索

- 在ES中增加了鼓励深入探索的能力。

- 这表明,通过探索代理群体来促进小规模进化神经网络探索的算法——特别是新颖性搜索(NS)和质量多样性(QD)算法——可以与ES杂交,以提高其在稀疏或欺骗性深度RL任务上的性能,同时保持可伸缩性。

- 证实了由此产生的新算法NS-ES和一个称为NSR-ES的QD-ES版本,避免了ES遇到的局部最优,从而在从模拟机器人学习绕过欺骗陷阱到玩雅达利游戏的高维像素到动作任务等任务上实现更高的性能。

- 将这个新的基于人群的探索算法家族添加到深度RL工具箱中。

2018年1月16日星期二更新:自发表以来,Uber AI实验室已经对本文中引用的算法进行了开源实现,链接如下:

欲了解未来Uber AI实验室博客文章的通知,请注册雷竞技到底好不好用我们的邮寄名单,或者你可以订阅优步AI实验室YouTube频道。如果你有兴趣加入Uber AI实验室,请在Uber.ai。

图片来源:Eric Frank